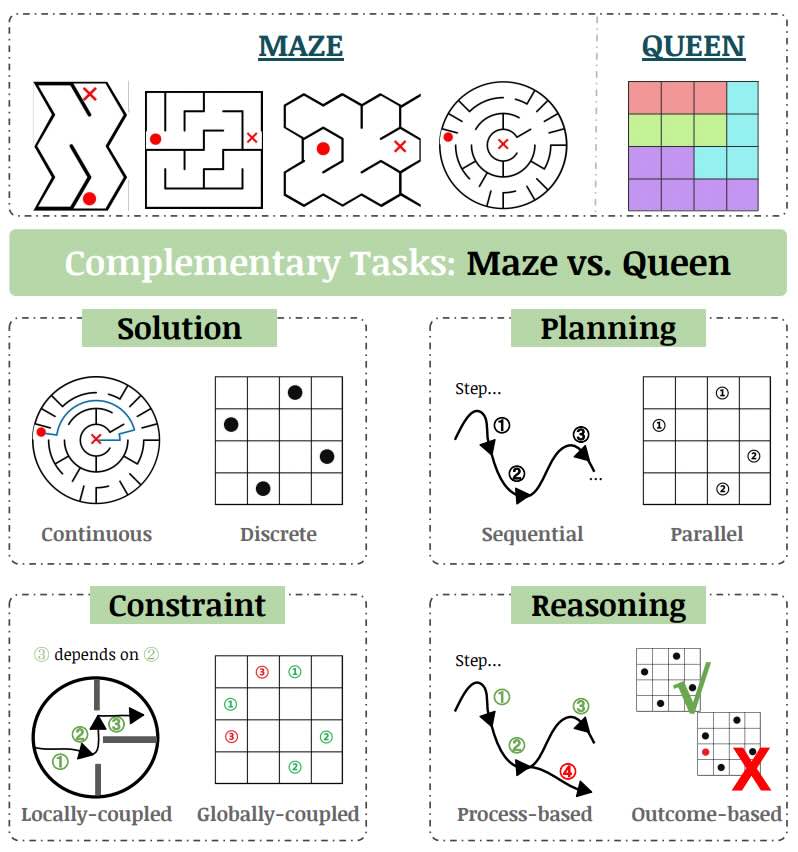

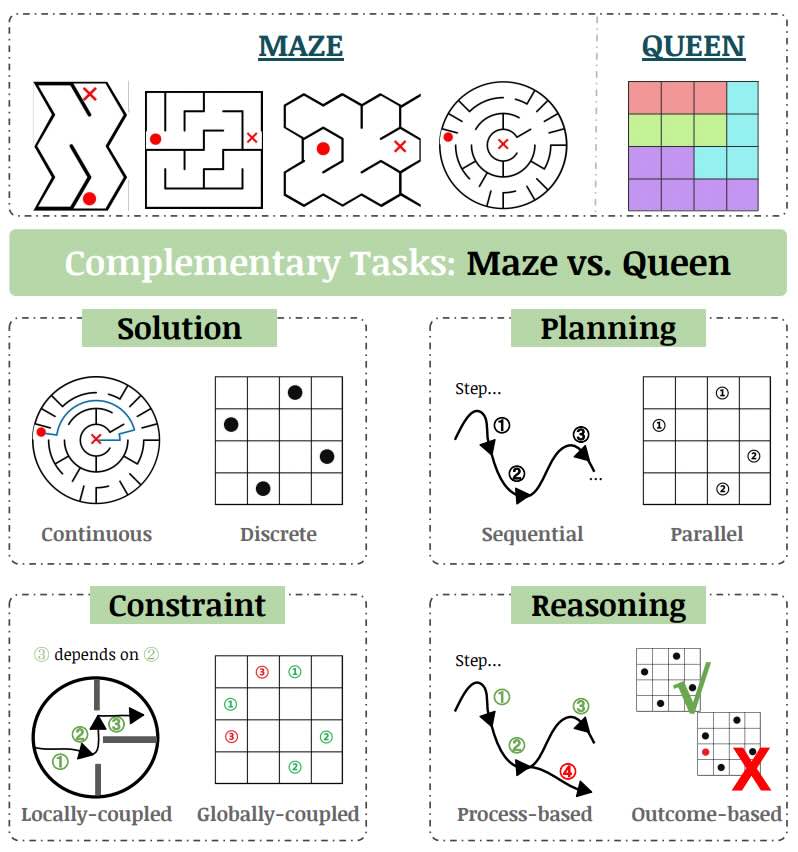

Amaze 提供了一種獨特的視覺規劃方法,透過先進的影像編輯模型來實現。這個儲存庫對於有興趣探索電腦視覺與AI驅動問題解決交集的研究人員和開發人員特別有價值。該專案專注於針對特定任務微調這些模型,例如導航迷宮,這需要對空間關係和模式識別有深入的理解。使用者應首先熟悉支援的模型,包括Bagel、Janus-Pro-7B和Qwen-Image-Edit,以及允許與外部服務靈活整合的API基於的模型。

在實踐中,Amaze通過應用監督式微調(SFT)技術來適應預訓練模型以符合迷宮解決任務的細微差異。該過程涉及使用config/資料夾中詳細指定的參數配置模型,其中maze.py包含Amaze Bench的特定設定。配置完成後,使用者可以進入sft/目錄執行為每個模型量身定做的微調腳本。此步驟對於優化目標任務的性能至關重要,確保模型能夠有效地解釋和操作視覺數據以解決迷宮。

使用Amaze的好處對於那些需要複雜視覺推理能力的專案最為顯著。機器人、自動系統和AI驅動遊戲等領域的研究人員可以利用此工具增強其應用程式在複雜環境中的導航能力。此外,希望將尖端影像編輯技術整合到產品中的開發人員會發現Amaze因其堅固的支持和清晰的文檔而無價。

然而,也有一些權衡需要考慮。對於初學者或沒有豐富機器學習經驗的人來說,設置和微調模型的複雜性可能會構成挑戰。根據專案規模的不同,訓練和推理所需的計算資源也可能相當龐大。使用者應仔細評估其硬體能力並分配足夠的時間進行實驗和優化。

要開始使用,請專注於理解專案結構。該儲存庫組織成幾個關鍵目錄:config/、data/、infer/、scripts/和sft/。每個目錄在工作流程中都具有不同的目的,從管理配置和加載數據集到執行推理和微調過程。特別注意infer/目錄,它包含了生成模型響應和計算評估指標的核心邏輯。該目錄中的maze_metrics.py文件尤其重要,因為它定義了用於評估模型在迷宮解決任務上表現的專業指標。

Amaze提供了一個全面的框架,用於在視覺規劃場景中利用影像編輯模型。雖然它需要一定的專業知識和資源投資,但在增強視覺推理能力方面的潛在收益使其成為相關領域專業人士值得追求的事業。透過仔細瀏覽其特點和功能,使用者可以解鎖AI驅動問題解決的新可能性。

Source: https://github.com/spatigen/amaze